实验一 Bayes 分类器的设计

一、 实验目的:

1. 对模式识别有一个初步的理解,能够根据自己的设计对贝叶斯决策理论算法有一个深刻地认识;

2. 理解二类分类器的设计原理。

二、 实验条件:

1. PC微机一台和MATLAB软件。

三、 实验原理:

最小风险贝叶斯决策可按下列步骤进行:

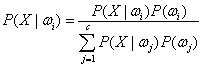

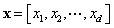

1. 在已知 ,

, ,

, 及给出待识别的

及给出待识别的 的情况下,根据贝叶斯公式计算出后验概率:

的情况下,根据贝叶斯公式计算出后验概率:

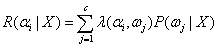

2. 利用计算出的后验概率及决策表,按下式计算出采取 决策的条件风险:

决策的条件风险:

3. 对2中得到的 个条件风险值

个条件风险值 (

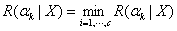

( )进行比较,找出使条件风险最小的决策

)进行比较,找出使条件风险最小的决策 ,即:

,即:

,

,

则 就是最小风险贝叶斯决策。

就是最小风险贝叶斯决策。

四、 实验内容:

假定某个局部区域细胞识别中正常( )和非正常(

)和非正常( )两类先验概率分别为:

)两类先验概率分别为:

正常状态: =0.9;

=0.9;

异常状态: =0.1。

=0.1。

现有一系列待观察的细胞,其观察值为 :

:

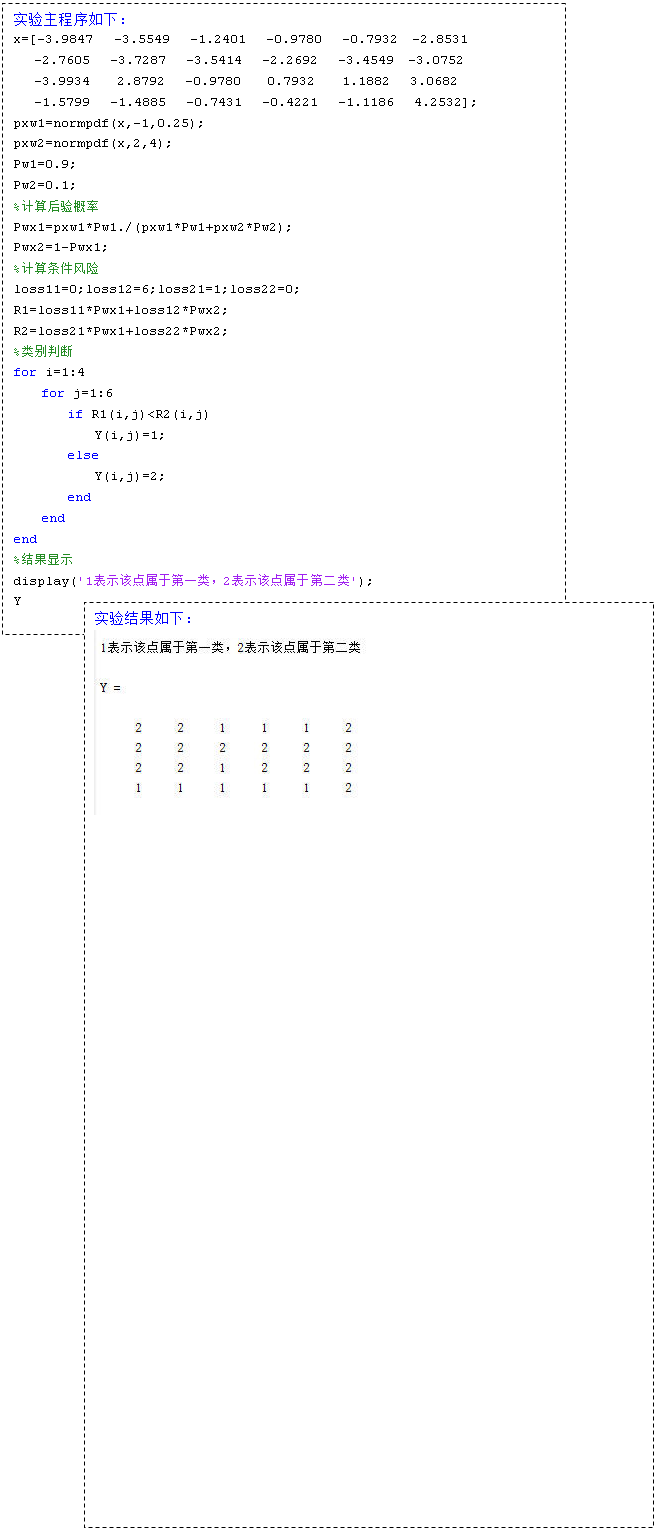

-3.9847 -3.5549 -1.2401 -0.9780 -0.7932 -2.8531

-2.7605 -3.7287 -3.5414 -2.2692 -3.4549 -3.0752

-3.9934 2.8792 -0.9780 0.7932 1.1882 3.0682

-1.5799 -1.4885 -0.7431 -0.4221 -1.1186 4.2532

类条件概率分布正态分布分别为(-2,0.25)(2,4)。决策表为

类条件概率分布正态分布分别为(-2,0.25)(2,4)。决策表为 (

( 表示

表示 的简写),

的简写), =6,

=6,  =1,

=1, =0。

=0。

试对观察的结果进行分类。

五、 实验程序及结果:

试验程序和曲线如下,分类结果在运行后的主程序中:

实验二 基于Fisher准则的线性分类器设计

一、 实验目的:

1. 进一步了解分类器的设计概念,能够根据自己的设计对线性分类器有更深刻地认识;

2. 理解Fisher准则方法确定最佳线性分界面方法的原理,以及拉格朗日乘子求解的原理。

二、 实验条件:

1. PC微机一台和MATLAB软件。

三、 实验原理:

设有一个集合包含N个d维样本 ,其中

,其中 个属于

个属于 类,

类, 个属于

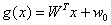

个属于 类。线性判别函数的一般形式可表示成

类。线性判别函数的一般形式可表示成 ,其中

,其中 。

。

根据Fisher选择投影方向 的原则,即使原样本向量在该方向上的投影能兼顾类间分布尽可能分开,类内样本投影尽可能密集的要求,用以评价投影方向

的原则,即使原样本向量在该方向上的投影能兼顾类间分布尽可能分开,类内样本投影尽可能密集的要求,用以评价投影方向 的函数为:

的函数为:

其中:

为

为 类中的第

类中的第 个样本

个样本

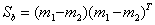

为类内离散度,定义为:

为类内离散度,定义为:

为类间离散度,定义为:

为类间离散度,定义为:

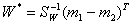

上面的公式是使用Fisher准则求最佳法线向量的解,我们称这种形式的运算为线性变换,其中 是一个向量,

是一个向量, 是

是 的逆矩阵,如

的逆矩阵,如 是

是 维,

维, 和

和 都是

都是 ×

× 维,得到的

维,得到的 也是一个

也是一个 维的向量。

维的向量。

向量 就是使Fisher准则函数

就是使Fisher准则函数 达极大值的解,也就是按Fisher准则将

达极大值的解,也就是按Fisher准则将 维

维 空间投影到一维

空间投影到一维 空间的最佳投影方向,该向量

空间的最佳投影方向,该向量 的各分量值是对原

的各分量值是对原 维特征向量求加权和的权值。

维特征向量求加权和的权值。

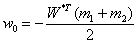

以上讨论了线性判别函数加权向量 的确定方法,并讨论了使Fisher准则函数极大的

的确定方法,并讨论了使Fisher准则函数极大的 维向量

维向量 的计算方法,但是判别函数中的另一项

的计算方法,但是判别函数中的另一项 尚未确定,一般可采用以下几种方法确定

尚未确定,一般可采用以下几种方法确定 如

如

或者

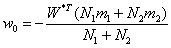

或当 与

与 已知时可用

已知时可用

当 确定之后,则可按以下规则分类,

确定之后,则可按以下规则分类,

四、 实验内容:

已知有两类数据 和

和 二者的概率已知

二者的概率已知 =0.6,

=0.6, =0.4。

=0.4。

中数据点的坐标对应一一如下:

中数据点的坐标对应一一如下:

=0.2331 1.5207 0.6499 0.7757 1.0524 1.1974

=0.2331 1.5207 0.6499 0.7757 1.0524 1.1974

0.2908 0.2518 0.6682 0.5622 0.9023 0.1333

-0.5431 0.9407 -0.2126 0.0507 -0.0810 0.7315

0.3345 1.0650 -0.0247 0.1043 0.3122 0.6655

0.5838 1.1653 1.2653 0.8137 -0.3399 0.5152

0.7226 -0.2015 0.4070 -0.1717 -1.0573 -0.2099

=2.3385 2.1946 1.6730 1.6365 1.7844 2.0155

=2.3385 2.1946 1.6730 1.6365 1.7844 2.0155

2.0681 2.1213 2.4797 1.5118 1.9692 1.8340

1.8704 2.2948 1.7714 2.3939 1.5648 1.9329

2.2027 2.4568 1.7523 1.6991 2.4883 1.7259

2.0466 2.0226 2.3757 1.7987 2.0828 2.0798

1.9449 2.3801 2.2373 2.1614 1.9235 2.2604

=0.5338 0.8514 1.0831 0.4164 1.1176 0.5536

=0.5338 0.8514 1.0831 0.4164 1.1176 0.5536

0.6071 0.4439 0.4928 0.5901 1.0927 1.0756

1.0072 0.4272 0.4353 0.9869 0.4841 1.0992

1.0299 0.7127 1.0124 0.4576 0.8544 1.1275

0.7705 0.4129 1.0085 0.7676 0.8418 0.8784

0.9751 0.7840 0.4158 1.0315 0.7533 0.9548

数据点的对应的三维坐标为:

数据点的对应的三维坐标为:

=1.4010 1.2301 2.0814 1.1655 1.3740 1.1829

=1.4010 1.2301 2.0814 1.1655 1.3740 1.1829

1.7632 1.9739 2.4152 2.5890 2.8472 1.9539

1.2500 1.2864 1.2614 2.0071 2.1831 1.7909

1.3322 1.1466 1.7087 1.5920 2.9353 1.4664

2.9313 1.8349 1.8340 2.5096 2.7198 2.3148

2.0353 2.6030 1.2327 2.1465 1.5673 2.9414

=1.0298 0.9611 0.9154 1.4901 0.8200 0.9399

=1.0298 0.9611 0.9154 1.4901 0.8200 0.9399

1.1405 1.0678 0.8050 1.2889 1.4601 1.4334

0.7091 1.2942 1.3744 0.9387 1.2266 1.1833

0.8798 0.5592 0.5150 0.9983 0.9120 0.7126

1.2833 1.1029 1.2680 0.7140 1.2446 1.3392

1.1808 0.5503 1.4708 1.1435 0.7679 1.1288

=0.6210 1.3656 0.5498 0.6708 0.8932 1.4342

=0.6210 1.3656 0.5498 0.6708 0.8932 1.4342

0.9508 0.7324 0.5784 1.4943 1.0915 0.7644

1.2159 1.3049 1.1408 0.9398 0.6197 0.6603

1.3928 1.4084 0.6909 0.8400 0.5381 1.3729

0.7731 0.7319 1.3439 0.8142 0.9586 0.7379

0.7548 0.7393 0.6739 0.8651 1.3699 1.1458

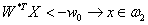

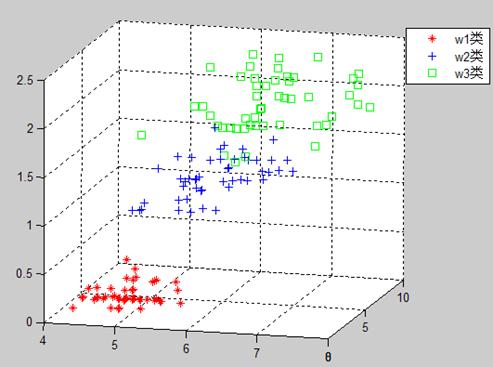

数据的样本点分布如下图:

根据所得结果判断(1,1.5,0.6)(1.2,1.0,0.55),(2.0,0.9,0.68),(1.2,1.5,0.89),(0.23,2.33,1.43),属于哪个类别,并画出数据分类相应的结果图,要求画出其在W上的投影。

五、 ![文本框: 程序清单:

x1=[0.2331 1.5207 0.6499 0.7757 1.0524 1.1974

0.2908 0.2518 0.6682 0.5622 0.9023 0.1333

-0.5431 0.9407 -0.2126 0.0507 -0.0810 0.7315

0.3345 1.0650 -0.0247 0.1043 0.3122 0.6655

0.5838 1.1653 1.2653 0.8137 -0.3399 0.5152

0.7226 -0.2015 0.4070 -0.1717 -1.0573 -0.2099];

y1=[2.3385 2.1946 1.6730 1.6365 1.7844 2.0155

2.0681 2.1213 2.4797 1.5118 1.9692 1.8340

1.8704 2.2948 1.7714 2.3939 1.5648 1.9329

2.2027 2.4568 1.7523 1.6991 2.4883 1.7259

2.0466 2.0226 2.3757 1.7987 2.0828 2.0798

1.9449 2.3801 2.2373 2.1614 1.9235 2.2604];

z1=[0.5338 0.8514 1.0831 0.4164 1.1176 0.5536

0.6071 0.4439 0.4928 0.5901 1.0927 1.0756

1.0072 0.4272 0.4353 0.9869 0.4841 1.0992

1.0299 0.7127 1.0124 0.4576 0.8544 1.1275

0.7705 0.4129 1.0085 0.7676 0.8418 0.8784

0.9751 0.7840 0.4158 1.0315 0.7533 0.9548];

x2=[1.4010 1.2301 2.0814 1.1655 1.3740 1.1829

1.7632 1.9739 2.4152 2.5890 2.8472 1.9539

1.2500 1.2864 1.2614 2.0071 2.1831 1.7909

1.3322 1.1466 1.7087 1.5920 2.9353 1.4664

2.9313 1.8349 1.8340 2.5096 2.7198 2.3148

2.0353 2.6030 1.2327 2.1465 1.5673 2.9414];

y2=[1.0298 0.9611 0.9154 1.4901 0.8200 0.9399

1.1405 1.0678 0.8050 1.2889 1.4601 1.4334

0.7091 1.2942 1.3744 0.9387 1.2266 1.1833

0.8798 0.5592 0.5150 0.9983 0.9120 0.7126

1.2833 1.1029 1.2680 0.7140 1.2446 1.3392

1.1808 0.5503 1.4708 1.1435 0.7679 1.1288];

z2=[0.6210 1.3656 0.5498 0.6708 0.8932 1.4342

0.9508 0.7324 0.5784 1.4943 1.0915 0.7644

1.2159 1.3049 1.1408 0.9398 0.6197 0.6603

1.3928 1.4084 0.6909 0.8400 0.5381 1.3729

0.7731 0.7319 1.3439 0.8142 0.9586 0.7379

0.7548 0.7393 0.6739 0.8651 1.3699 1.1458];](https://upload2.fanwen118.com/wk001/3687853/3687853_img_068.png) 实验程序及结果:

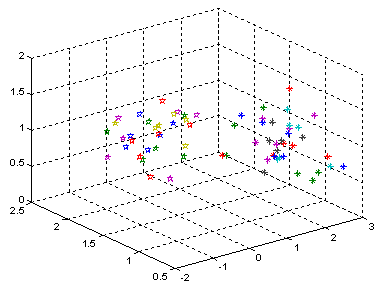

实验程序及结果:

☆实验总结:

通过本次实验我进一步熟悉了Bayes判别和Fisher线性判别的相关知识。Bayes判别的关键在于计算后验概率,而Fisher线性判别的关键在于找准投影方向使类内聚集内间分离。此外还在一定程度上锻炼了我的编程能力及对matlab的使用。

第二篇:《模式识别》实验报告-贝叶斯分类

《模式识别》实验报告

---最小错误率贝叶斯决策分类

一、实验原理

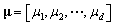

对于具有多个特征参数的样本(如本实验的iris数据样本有 个参数),其正态分布的概率密度函数可定义为

个参数),其正态分布的概率密度函数可定义为

式中, 是

是 维行向量,

维行向量, 是

是 维行向量,

维行向量, 是

是 维协方差矩阵,

维协方差矩阵, 是

是 的逆矩阵,

的逆矩阵, 是

是 的行列式。

的行列式。

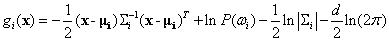

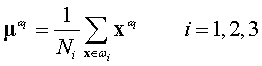

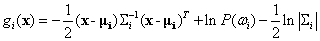

本实验我们采用最小错误率的贝叶斯决策,使用如下的函数作为判别函数

(3个类别)

(3个类别)

其中 为类别

为类别 发生的先验概率,

发生的先验概率, 为类别

为类别 的类条件概率密度函数。

的类条件概率密度函数。

由其判决规则,如果使 对一切

对一切 成立,则将

成立,则将 归为

归为 类。

类。

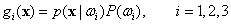

我们根据假设:类别 ,i=1,2,……,N的类条件概率密度函数

,i=1,2,……,N的类条件概率密度函数 ,i=1,2,……,N服从正态分布,即有

,i=1,2,……,N服从正态分布,即有 ~

~ ,那么上式就可以写为

,那么上式就可以写为

对上式右端取对数,可得

上式中的第二项与样本所属类别无关,将其从判别函数中消去,不会改变分类结果。则判别函数 可简化为以下形式

可简化为以下形式

二、实验步骤

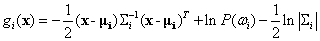

(1)从Iris.txt文件中读取估计参数用的样本,每一类样本抽出前40个,分别求其均值,公式如下

clear

% 原始数据导入

iris = load('C:\MATLAB7\work\模式识别\iris.txt');

N=40;%每组取N=40个样本

%求第一类样本均值

for i = 1:N

for j = 1:4

w1(i,j) = iris(i,j+1);

end

end

sumx1 = sum(w1,1);

for i=1:4

meanx1(1,i)=sumx1(1,i)/N;

end

%求第二类样本均值

for i = 1:N

for j = 1:4

w2(i,j) = iris(i+50,j+1);

end

end

sumx2 = sum(w2,1);

for i=1:4

meanx2(1,i)=sumx2(1,i)/N;

end

%求第三类样本均值

for i = 1:N

for j = 1:4

w3(i,j) = iris(i+100,j+1);

end

end

sumx3 = sum(w3,1);

for i=1:4

meanx3(1,i)=sumx3(1,i)/N;

end

(2)求每一类样本的协方差矩阵、逆矩阵 以及协方差矩阵的行列式

以及协方差矩阵的行列式 ,

,

协方差矩阵计算公式如下

其中

代表

代表 类的第

类的第 个样本,第j个特征值;

个样本,第j个特征值;

代表

代表 类的

类的 个样品第j个特征的平均值

个样品第j个特征的平均值

代表

代表 类的第l个样品,第k个特征值;

类的第l个样品,第k个特征值;

代表

代表 类的

类的 个样品第k个特征的平均值。

个样品第k个特征的平均值。

%求第一类样本协方差矩阵

z1(4,4) = 0;

var1(4,4) = 0;

for i=1:4

for j=1:4

for k=1:N

z1(i,j)=z1(i,j)+(w1(k,i)-

meanx1(1,i))*(w1(k,j)-meanx1(1,j));

end

var1(i,j) = z1(i,j) / (N-1);

end

end

%求第二类样本协方差矩阵

z2(4,4) = 0 ;

var2(4,4) = 0;

for i=1:4

for j=1:4

for k=1:N

z2(i,j)=z2(i,j)+

(w2(k,i)-meanx2(1,i))*(w2(k,j)-meanx2(1,j));

end

ar2(i,j) = z2(i,j) / (N-1);

end

end

%求第三类样本协方差矩阵

z3(4,4) = 0 ;

var3(4,4) = 0;

for i=1:4

for j=1:4

for k=1:N

z3(i,j)=z3(i,j)+(w3(k,i)-

meanx3(1,i))*(w3(k,j)-meanx3(1,j));

end

var3(i,j) = z3(i,j) /( N-1);

end

end

%求各类的协方差矩阵逆矩阵及行列式

var1_inv = [];var1_det = [];

var2_inv = [];var2_det = [];

var3_inv = [];var3_det = [];

var1_inv = inv(var1)

var2_inv = inv(var2)

var3_inv = inv(var3)

var1_det = det(var1)

var2_det = det(var2)

var3_det = det(var3)

(3)对三个类别,分别取每组剩下的10个样本,每两组进行分类。由于每一类样本都相等,且每一类选取用作训练的样本也相等,在每两组进行分类时,待分类样本的类先验概率 。将各个样本代入判别函数

。将各个样本代入判别函数

根据判决规则,如果使 对一切

对一切 成立,则将

成立,则将 归为

归为 类。

类。

若取第一类后10个数据和第二类进行分类,代码如下

M=10;

for i = 1:M

for j = 1:4

test(i,j) = iris(i+50,j+1); % 取测试数据

end

end

t1=0;t2=0;t3=0;

for i = 1:M

x=test(i,1);y=test(i,2);

z=test(i,3);h=test(i,4);

g1 = (-0.5)*([x,y,z,h]-meanx1)*var1_inv*([x,y,z,h]'-meanx1') - 0.5*log(abs(var1_det)) + log(p1);

g2 = (-0.5)*([x,y,z,h]-meanx2)*var2_inv*([x,y,z,h]'-meanx2') - 0.5*log(abs(var2_det)) + log(p2);

if g1>g2

t1=t1+1 %若g1>g2,则属于第一类,否则属于第二类,并统计属于每一类的个数

else

t2=t2+1

end

end

同理第二类和第三类、第一类和第三类可进行分类。

三、实验结果及分析

(1)取第一类样本的后10个数据,按 、

、 分类,由t1=10可知,此10个数据属于

分类,由t1=10可知,此10个数据属于 ,分类正确;同理,按

,分类正确;同理,按 、

、 分类,由t1=10可知,此10个数据属于

分类,由t1=10可知,此10个数据属于 ,分类正确。

,分类正确。

(2)取第二类样本的后10个数据,按 、

、 分类,由t2=10可知,此10个数据属于

分类,由t2=10可知,此10个数据属于 ,分类正确;同理,按

,分类正确;同理,按 、

、 分类,由t2=10可知,此10个数据属于

分类,由t2=10可知,此10个数据属于 ,分类正确。

,分类正确。

(3)取第三类样本的后10个数据,按 、

、 分类,由t3=10可知,此10个数据属于

分类,由t3=10可知,此10个数据属于 ,分类正确;同理,按

,分类正确;同理,按 、

、 分类,由t3=10可知,此10个数据属于

分类,由t3=10可知,此10个数据属于 ,分类正确。

,分类正确。

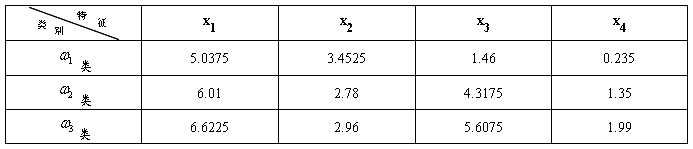

(4)表1为 、

、 、

、 的样本类的均值。

的样本类的均值。

表1 三类样本均值

由上表可知,对于 、

、 、

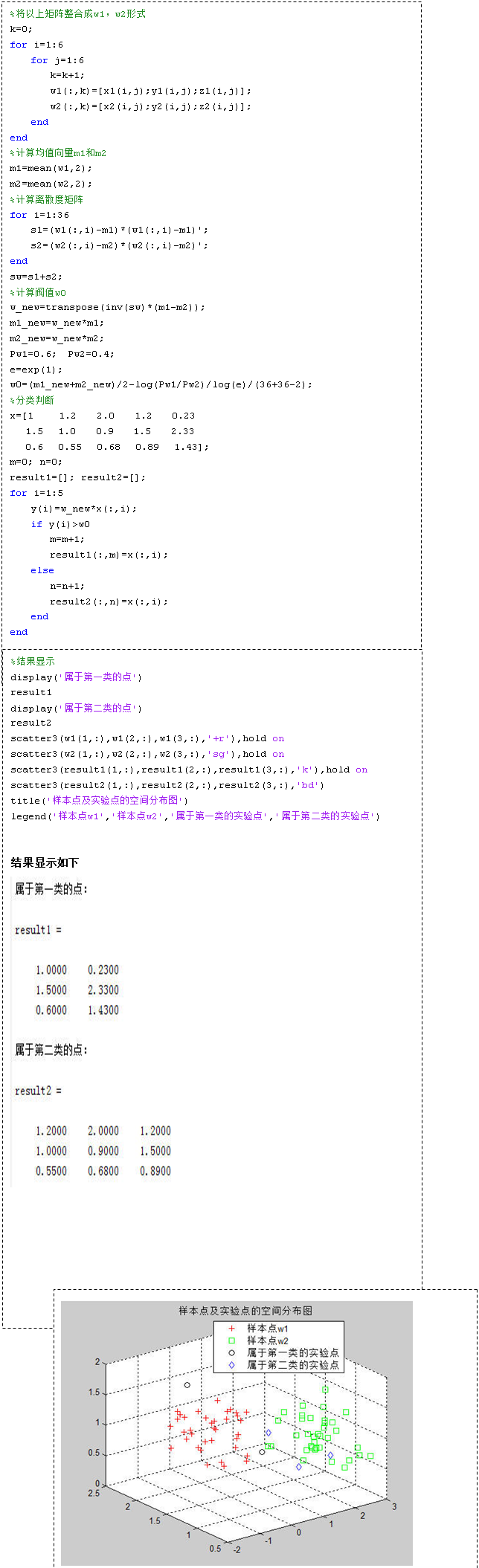

、 三个类样本,它们的第二个特征均值x2相差不大,对于分类取得作用不如其他3个特征作用大,因此我们略去第二个特征,在三维坐标空间画出降为3维主特征的3类样本点的空间分布,如图1所示

三个类样本,它们的第二个特征均值x2相差不大,对于分类取得作用不如其他3个特征作用大,因此我们略去第二个特征,在三维坐标空间画出降为3维主特征的3类样本点的空间分布,如图1所示

图1 去掉第二维特征的三类样本空间位置

上图中,“*”为 类,“+”为

类,“+”为 类,“□”为

类,“□”为 类,显然

类,显然 类和

类和 类以及

类以及 类特征差异比较明显,而

类特征差异比较明显,而 类与

类与 类差异较小,对于位于

类差异较小,对于位于 、

、 类类间分解面附近的样本,使用最小错误率贝叶斯决策时,可能会出现错分情况。在实验中,我们对

类类间分解面附近的样本,使用最小错误率贝叶斯决策时,可能会出现错分情况。在实验中,我们对 类50个样本分类,结果为t2 =48 ,t3 =2,错分2个到

类50个样本分类,结果为t2 =48 ,t3 =2,错分2个到 类;对

类;对 类50个样本分类,结果为t2 =0 ,t3 =50,分类正确。

类50个样本分类,结果为t2 =0 ,t3 =50,分类正确。

附:iris数据

1 5.1 3.5 1.4 0.2

2 4.9 3.0 1.4 0.2

3 4.7 3.2 1.3 0.2

4 4.6 3.1 1.5 0.2

5 5.0 3.6 1.4 0.2

6 5.4 3.9 1.7 0.4

7 4.6 3.4 1.4 0.3

8 5.0 3.4 1.5 0.2

9 4.4 2.9 1.4 0.2

10 4.9 3.1 1.5 0.1

11 5.4 3.7 1.5 0.2

12 4.8 3.4 1.6 0.2

13 4.8 3.0 1.4 0.1

14 4.3 3.0 1.1 0.1

15 5.8 4.0 1.2 0.2

16 5.7 4.4 1.5 0.4

17 5.4 3.9 1.3 0.4

18 5.1 3.5 1.4 0.3

19 5.7 3.8 1.7 0.3

20 5.1 3.8 1.5 0.3

21 5.4 3.4 1.7 0.2

22 5.1 3.7 1.5 0.4

23 4.6 3.6 1.0 0.2

24 5.1 3.3 1.7 0.5

25 4.8 3.4 1.9 0.2

26 5.0 3.0 1.6 0.2

27 5.0 3.4 1.6 0.4

28 5.2 3.5 1.5 0.2

29 5.2 3.4 1.4 0.2

30 4.7 3.2 1.6 0.2

31 4.8 3.1 1.6 0.2

32 5.4 3.4 1.5 0.4

33 5.2 4.1 1.5 0.1

34 5.5 4.2 1.4 0.2

35 4.9 3.1 1.5 0.2

36 5.0 3.2 1.2 0.2

37 5.5 3.5 1.3 0.2

38 4.9 3.6 1.4 0.1

39 4.4 3.0 1.3 0.2

40 5.1 3.4 1.5 0.2

41 5.0 3.5 1.3 0.3

42 4.5 2.3 1.3 0.3

43 4.4 3.2 1.3 0.2

44 5.0 3.5 1.6 0.6

45 5.1 3.8 1.9 0.4

46 4.8 3.0 1.4 0.3

47 5.1 3.8 1.6 0.2

48 4.6 3.2 1.4 0.2

49 5.3 3.7 1.5 0.2

50 5.0 3.3 1.4 0.2

51 7.0 3.2 4.7 1.4

52 6.4 3.2 4.5 1.5

53 6.9 3.1 4.9 1.5

54 5.5 2.3 4.0 1.3

55 6.5 2.8 4.6 1.5

56 5.7 2.8 4.5 1.3

57 6.3 3.3 4.7 1.6

58 4.9 2.4 3.3 1.0

59 6.6 2.9 4.6 1.3

60 5.2 2.7 3.9 1.4

61 5.0 2.0 3.5 1.0

62 5.9 3.0 4.2 1.5

63 6.0 2.2 4.0 1.0

64 6.1 2.9 4.7 1.4

65 5.6 2.9 3.6 1.3

66 6.7 3.1 4.4 1.4

67 5.6 3.0 4.5 1.5

68 5.8 2.7 4.1 1.0

69 6.2 2.2 4.5 1.5

70 5.6 2.5 3.9 1.1

71 5.9 3.2 4.8 1.8

72 6.1 2.8 4.0 1.3

73 6.3 2.5 4.9 1.5

74 6.1 2.8 4.7 1.2

75 6.4 2.9 4.3 1.3

76 6.6 3.0 4.4 1.4

77 6.8 2.8 4.8 1.4

78 6.7 3.0 5.0 1.7

79 6.0 2.9 4.5 1.5

80 5.7 2.6 3.5 1.0

81 5.5 2.4 3.8 1.1

82 5.5 2.4 3.7 1.0

83 5.8 2.7 3.9 1.2

84 6.0 2.7 5.1 1.6

85 5.4 3.0 4.5 1.5

86 6.0 3.4 4.5 1.6

87 6.7 3.1 4.7 1.5

88 6.3 2.3 4.4 1.3

89 5.6 3 4.1 1.3

90 5.5 2.5 4.0 1.3

91 5.5 2.6 4.4 1.2

92 6.1 3.0 4.6 1.4

93 5.8 2.6 4.0 1.2

94 5.0 2.3 3.3 1.0

95 5.6 2.7 4.2 1.3

96 5.7 3.0 4.2 1.2

97 5.7 2.9 4.2 1.3

98 6.2 2.9 4.3 1.3

99 5.1 2.5 3.0 1.1

100 5.7 2.8 4.1 1.3

101 6.3 3.3 6.0 2.5

102 5.8 2.7 5.1 1.9

103 7.1 3.0 5.9 2.1

104 6.3 2.9 5.6 1.8

105 6.5 3.0 5.8 2.2

106 7.6 3.0 6.6 2.1

107 4.9 2.5 4.5 1.7

108 7.3 2.9 6.3 1.8

109 6.7 2.5 5.8 1.8

110 7.2 3.6 6.1 2.5

111 6.5 3.2 5.1 2.0

112 6.4 2.7 5.3 1.9

113 6.8 3.0 5.5 2.1

114 5.7 2.5 5.0 2.0

115 5.8 2.8 5.1 2.4

116 6.4 3.2 5.3 2.3

117 6.5 3.0 5.5 1.8

118 7.7 3.8 6.7 2.2

119 7.7 2.6 6.9 2.3

120 6.0 2.2 5.0 1.5

121 6.9 3.2 5.7 2.3

122 5.6 2.8 4.9 2.0

123 7.7 2.8 6.7 2.0

124 6.3 2.7 4.9 1.8

125 6.7 3.3 5.7 2.1

126 7.2 3.2 6.0 1.8

127 6.2 2.8 4.8 1.8

128 6.1 3.0 4.9 1.8

129 6.4 2.8 5.6 2.1

130 7.2 3.0 5.8 1.6

131 7.4 2.8 6.1 1.9

132 7.9 3.8 6.4 2.0

133 6.4 2.8 5.6 2.2

134 6.3 2.8 5.1 1.5

135 6.1 2.6 5.6 1.4

136 7.7 3.0 6.1 2.3

137 6.3 3.4 5.6 2.4

138 6.4 3.1 5.5 1.8

139 6.0 3.0 4.8 1.8

140 6.9 3.1 5.4 2.1

141 6.7 3.1 5.6 2.4

142 6.9 3.1 5.1 2.3

143 5.8 2.7 5.1 1.9

144 6.8 3.2 5.9 2.3

145 6.7 3.3 5.7 2.5

146 6.7 3 5.2 2.3

147 6.3 2.5 5 1.9

148 6.5 3 5.2 2

149 6.2 3.4 5.4 2.3

150 5.9 3 5.1 1.8